2025 ai agent迷局:誰在玩真的,誰在演戲?

文章來源:適道

image source: generated by ai

image source: generated by ai

2023年底,史丹福大學發布了一款引發轟動的ai實驗項目–"小鎮模擬遊戲"。在這個虛擬小鎮裡,25個ai角色能夠自主交談、建立關係、制定計劃,展現出了令人驚嘆的社交能力。這個實驗讓人們第一次對ai agent(智能體)產生了期待–具有自主意識和決策能力的ai助手指日可待。

一年過去了,ai agent的概念在業界炙手可熱。微軟、google等科技巨頭紛紛布局,初創公司們也爭相推出各類"agent"產品。然而,當我們仔細觀察這些號稱是"agent"的產品時,會發現一個尷尬的現實:它們與真正的agent相去甚遠,更像是僅僅具備自然語言理解能力的對話機器人。

這種"形似神不似"的現象,在ai硬體領域也不斷上演。2024年10月,智能戒指品牌oura推出了最新款oura ring 4,並"識時務"地加入了ai功能。很快,oura估值超50億美金,成為了商業化最成功的"ai硬體"廠商之一。然而,一個共識是:oura的成功與ai關係並不大,其核心價值仍在於健康追蹤這一基礎功能。相比之下,真正主打ai的硬體產品,如ai pin、rabbit r1卻遭遇了"上市即翻車"的命運。

什麼稱得上ai agent?隨手打開一個大模型app,映入眼帘的prompt agent?還是編程領域的專業 agent cursor?亦或是鋼鐵俠的全能助手jarvis?

美國vc madrona合伙人jon turow曾指出:當你聊過足夠多的從業者,你會發現有一系列不同概念的東西,它們都叫做agent 。

如果將ai agent形容為一場馬拉松,2025年的ai agent行至何處?

1、2024年ai agent觀察:一半是海水,一半是火焰

- 熱鬧的景象:各路玩家就位

2024上半年,大模型價格戰還在轟轟烈烈進行;下半年,ai agent爭奪戰就已經蓄勢待發。

海外市場,openai、anthropic、微軟、谷歌等科技巨頭紛紛公布相關進展,將自家agent實力當作牌桌上的重要籌碼。

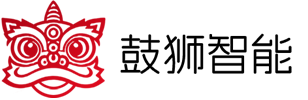

10月,anthropic 推出了名為“computer use”的ai agent系統,號稱能夠“像人一樣操作計算機”。這是一個特殊api,允許開發者指導 claude完成各種計算機操作任務–觀察屏幕內容、移動滑鼠、點擊按鈕以及打字等等。開發者可以通過該 api 將書面指令轉換為具體的計算機指令,從而實現自動化任務。

(圖片:anthropic開發人員演示computer use)

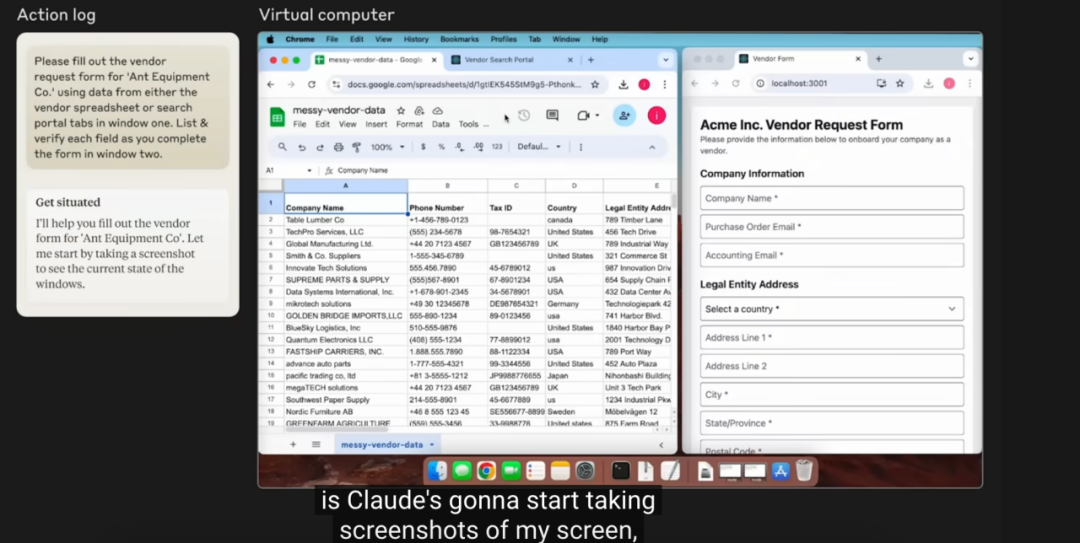

微軟也是ai agent的重要推動者。2024年10 月,微軟公布了一項重要計劃:面向 dynamics 365業務應用平台,開發部署10款ai agent–將主要服務於企業的銷售環節、會計業務以及客戶服務等關鍵領域。按照時間表,這些ai agent將在年底開放公測,測試階段預計延續到 2025 年初期。

(圖片:微軟ceo展示copilot與ai堆棧)

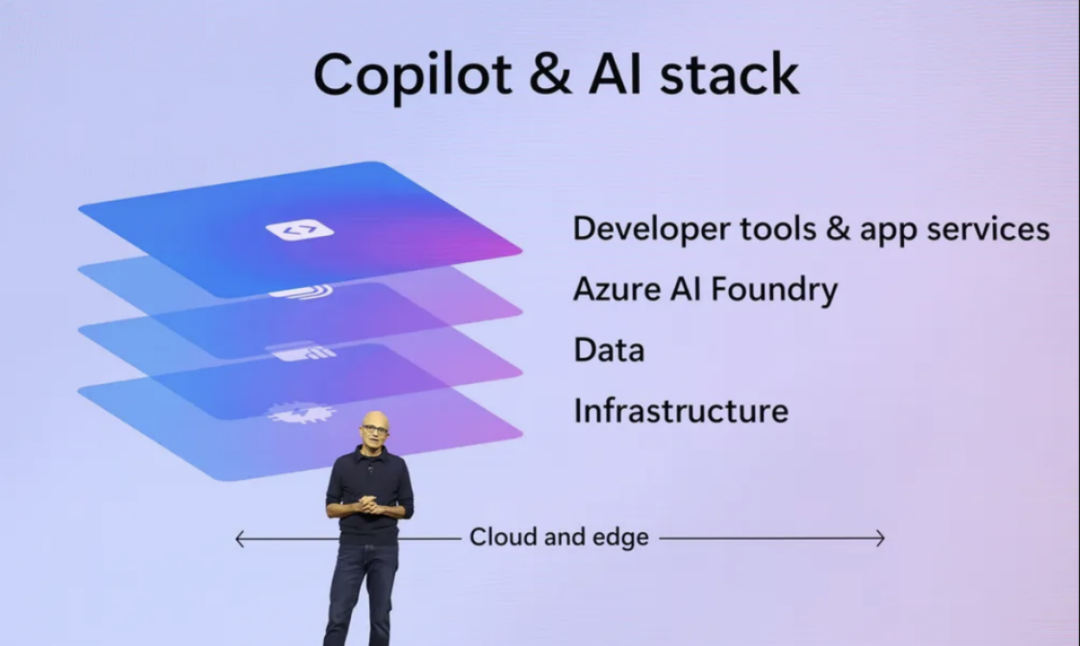

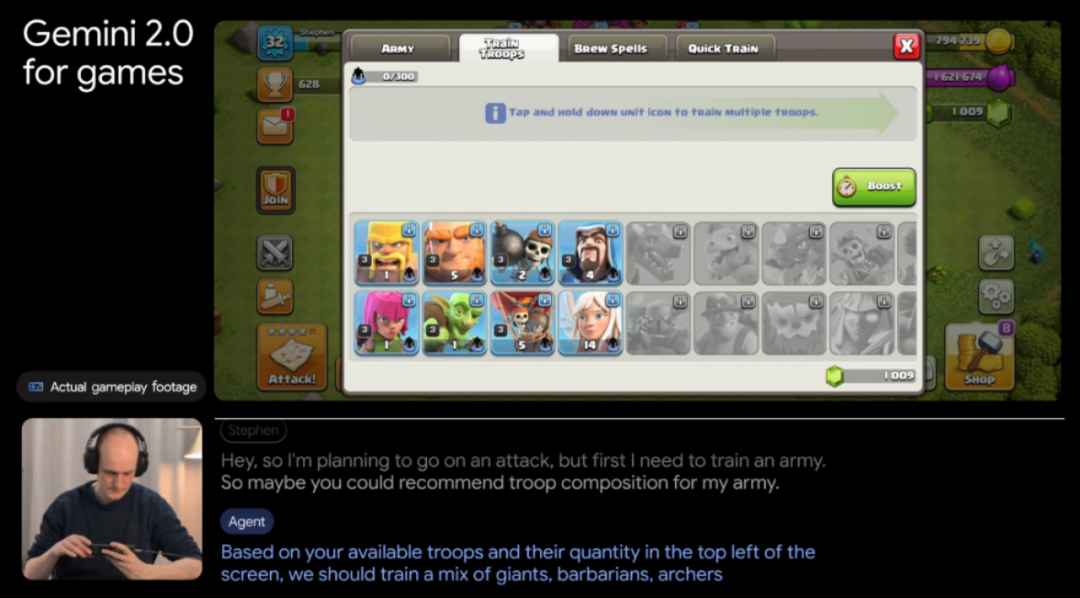

谷歌的反應相對較慢,但在年底也趕上了進度。12月,谷歌發布了全新多模態大模型gemini 2.0。在新模型的加持下,谷歌內置了三款ai agent–“通用大模型助手”project astra、“瀏覽器助手”project mariner 和“編程助手”jules。

“編程助手”jules能夠作為自主代理直接集成到github的工作流程系統中,分析複雜的代碼庫,跨多個文件實施修復,並準備詳細的拉取請求,無需持續的人工監督;而在遊戲《部落衝突》演示中,谷歌ai agent不僅能夠向玩家居間兵種特性,給出組合建議,還可以在reddit檢索信息,為玩家提供角色選擇建議。

(圖片:玩家與谷歌ai agent互動)

openai雖然是基礎模型的領先者,在agent方面布局卻略顯遲緩。7月,openai 更新agi路線圖,並指出自己處於第一層,接近達到第二層;而第三層才是ai agent。

(圖片:openai 定義的人工智慧發展 5 階段)

openai預計將於2025年1月推出全新ai agent–operator,該系統能夠自動執行各種複雜操作,包括編寫代碼、預訂旅行、自動電商購物等。據悉,operator可能會在computer use的基礎上進行大幅度創新和應用簡化,擴大ai agent的使用範圍和應用場景。

國內市場,百度、阿里、騰訊、智譜等大廠也紛紛入局。

在b端,百度文心智能體平台、騰訊元器、訊飛星火智能體創作中心、通義智能體、字節扣子等面向企業用戶提供了智能體創建平台,並開始在其ai智能助手界面中添加ai agent入口。

在c端,支付寶旗下ai app支小寶、智譜autoglm點燃了消費者用戶的激情。根據演示,智譜autoglm能夠瀏覽並理解屏幕信息,做出任務規劃,實現手機上常用操作的模擬執行–只需接收簡單的文字/語音指令,它就可以模擬人類操作手機,在朋友圈點讚,在美團點外賣,在攜程訂酒店等等。

- 冷靜的現實:當我們在談論ai agent時,到底是在談論什麼?

如果只看到上述的熱鬧景象,你大概會得出結論–2024年是ai agent的當打之年。

但用戶能夠真正依賴的ai agent,其實寥寥無幾。

只需花3秒鐘思考–你喜歡用哪幾款ai agent?如果你是程式設計師,答案可能只是cursor。如果我們換個問題–你喜歡用哪幾款ai大模型?答案會五花八門,比如chatgpt、gemini、claude、kimi等等。

至少從實感來說,目前大熱的ai agent仍是“虛火”。

主因是“不靠譜”和“雞肋”。ai agent依賴llm“黑盒”,本身就存在不可預測性,而工作流程更是要將多個ai 步驟連接起來,會加劇這些問題,尤其是對於需要精確輸出的任務。用戶難以確保agent能否始終提供準確、符合上下文的響應。

langchain發布的state of ai agents可以作為重要參考。其調查涉及的1300多位受訪者指出,性能質量(41%)是首要關注點,重要性遠超成本(18.4%)和安全(18.4%)等因素。甚至對於向來格外關注成本的小企業而言,其中45.8%將性能質量列為主要關注點,成本因素僅為22.4%。同時,報告指出,生產中採用ai agents的主要挑戰包括:開發人員很難向團隊和利益相關者解釋 ai agent 的功能和行為。

此外,雖然ai agent依賴的基座llms在tool use方面表現不錯,但它們速度不快且成本高,特別是需要進行循環和自動重試時。webarena 排行榜對 llm智能體在現實任務中的表現進行了基準測試。結果顯示,即便是表現最好的模型step,成功率也只有35.8%,而gpt-4的成功率僅達到14.9%。

那麼,市面上不能“完全自理”的ai agent算得上agent嗎?

如果我們按吳恩達的思路就很好理解了–ai agent是可以分層級的。他提出了agentic system(智能體系統),並認為形容詞“agentic”比名詞“agent”能更好地幫助我們理解這類智能體的本質。如同自動駕駛汽車l1-l4,agent的進化也是一個過程。

babyagi創始人yohei nakajima對於ai agent的分類,同樣值得參考。

1、手工製作agent:由 prompt和api 調用組成的鏈條,具有一定自主性,但約束較多。

特徵:流水線機器人,按照固定步驟完成任務。

舉例:它就像一個專門訂票的助手–當你告訴航班需求時,它能夠直接調用api搜索並完成預訂;然而一旦涉及複雜行程規劃,手工製作agent就會“卡住”(歡迎大家代入產品)。

2、專業agent:在一組任務類型和工具內動態決定要做什麼,比手工製作agent約束少。

特徵:嫻熟工匠,能夠在特定領域(比如木工)熟練地使用工具,不僅能按照要求製作家具,還能根據實際需求調整設計,調用材料。

舉例:autogpt通過cot技術分解複雜問題,動態選擇最優解決路徑。面對一個市場研究任務,autogpt能自動分解任務為“搜索趨勢”“整理數據”“生成報告”等子任務並完成。

3、通用agent:agent的agi–目前還處於理論概念階段,尚未實現。

特徵:全能助手,就像鋼鐵俠的jarvis。你可以詢問它任何問題,它不僅能理解你的需求,還能結合知識和環境動態適應,提供創新解決方案。

舉例:還沒有真正能實現的產品,相關研究包括更強的多模態交互和長期記憶優化。

處於當前的歷史節點,prompt agent數量最多,表現為大模型app里的遍地agent;垂直領域的專業agent正處於爆點,並因其實用性備受資本青睞;人類所期待的真正agent–全能助手jarvis,有待關鍵技術突破。這也意味著未來一段時間內,我們能看到更多“l1-l4”之間的技術進化。

- 這一年ai agent“皮下”技術進化到哪兒了?

根據lilian weng列舉的公式:agent = llm+memory+planning skills+tool use

假設你是黑暗料理界的“五虎星”。llm代表你的知識儲備,包含所有菜系菜譜;memory類似於你的廚師筆記,記錄著不同食客的口味需求,輸給“小當家”的歷史教訓;planning好比你的做菜規劃,面對不同要求,是先炸再烤,還是先煮再炸;tools則是你的魔法廚具,包括如何調用不同刀具(軟體),幫助執行複雜的任務。

ai agent的突破取決於各項技術的進步。

首先是llm。在gpt5這樣的強悍“大腦”出現之前,openai就發現了推理引擎的能力。

2024年10月,openai高級研究科學家、德撲ai之父noam brown提出:讓ai模型思考20秒所帶來的性能提升,相當於將模型擴大100,000倍並訓練100,000倍的時間。

brown所指的技術便是system 1/2 thinking,正是openai o1長出“推理能力”的秘訣。

system 1,即“快思考”,你看到一隻蘋果,不需要思考,就知道這是水果;system 2,即“慢思考”,你要做一道17*24的數學題,則需拆解步驟來思考,答案才更準確。

近期,谷歌deepmind研究人員也將這項技術集成到ai agent中,並開發了talker-reasoner框架。system 1是默認運行的“快速模式”,而system 2作為“備用引擎”隨時待命。當system 1感到困惑時,會將任務交給system 2處理。“雙引擎”共同運行,對於解決複雜、冗長的任務幫助巨大,突破了傳統ai agent執行業務流程的方法,極大提升了效率。

其次是記憶機制。當生成式ai開始“胡言亂語”,或許不是性能問題,而是記憶力不佳。這時候就需要rag(檢索增強型生成)來幫忙。它是llm“外掛”般的存在,能夠利用外部知識庫為llm提供相關上下文,防止llm不懂裝懂。

然而,傳統rag流程只考慮一個外部知識源,不能調用外部工具;僅生成一次性解決方案,上下文只檢索一次,不能進行推理或驗證。

在此情況下,融合agent能力的rag應運而生。雖然agentic rag在整體流程上與傳統rag一脈相承:檢索-合成上下文-生成,但其融入了agent自主規劃能力,能夠適應更加複雜的rag查詢任務–決定是否需要檢索;自主決策使用哪個檢索引擎自主規劃使用檢索引擎的步驟;評估檢索到的上下文,並決定是否重新檢索;自行規劃是否需要藉助外部工具。

如果說,原始rag是坐在圖書館查看特定問題;那麼,agentic rag就像拿著iphone,調用google瀏覽器、電子郵件等等搜索問題。

此外,2024年yc孵化的開源mem0項目,也有望成為rag助手,並為ai agent插上個性化記憶的翅膀。

mem0像是大腦的“海馬體”,為llm提供了一個智能、自我優化的記憶層。它能進行信息分層存儲–將短時信息轉化為長期記憶。類似於,你會整理“新學知識”,而後存入腦海;它還能建立語義連結–通過語義分析為存儲的知識創建關聯網絡。類似於,你告訴 ai自己喜歡看偵探電影,它不僅能記住,還會推測你可能喜歡的犯罪紀錄片。

基於此,mem0能夠顯著提升ai agent個性化記憶–動態記錄用戶偏好、行為和需求,創建“私人記事本”。例如,當你告訴ai agent下周是媽媽生日,它不僅會及時提醒你送上祝福,還會根據“記憶中”你和媽媽的喜好,給出送禮建議,甚至能夠跨平台“貨比三家”,奉上購物連結。

在rag方面的突破不止於此,俄亥俄州立大學和史丹福大學的科學家團隊提出了一個有趣的思路:讓ai擁有一個類似人類海馬體的“記憶大腦”。他們從神經科學的角度出發,模仿人腦海馬體在長期記憶中的作用,設計出一個名為hipporag的模型,像人腦一樣高效地整合和搜索知識。實驗表明,“記憶大腦”能夠在多跳問答等需要知識整合的任務上取得大幅提升。或許探索出讓大模型具備“類人”記憶的一個全新方向。

tool use的進步更是肉眼看見。例如,claude的computer use,通過構建api,將自然語言提示轉化為各種電腦操作指令,由開發者自動化重複性的任務、進行測試和質量保證,以及開放式研究。從此,ai不需要一個個專門的api“鑰匙”也能“一次性”調用各種軟體完成各種操作:用word寫文檔,用excel處理表格,用瀏覽器搜索信息。雖然如此,目前computer use能力還不完善:不能在內部數據上訓練該功能;受限於上下文窗口等等。anthropic團隊也表示,現在claude的計算機使用水平只處於類似“gpt-3 時代”的早期階段,未來還有很大提升空間。

值得注意的是,ai agent的視覺能力也取得了進步。例如,智譜發布的 glm-pc 將其通用的視覺-操作模型 cogagent 應用到了計算機上。其能夠模擬人類的視覺感知來從環境中獲取信息輸入,以進行進一步的推理和決策。

規劃能力方面。planning包含任務分解–將大任務劃分成小任務;反思和提煉–基於已有動作進行自我反思,從錯誤中學習優化接下來的動作。

目前,有論文提出更為新穎的分類法:任務分解、多計劃選擇、外部模塊輔助規劃、反思與細化、記憶增強規劃。其中,多計劃選擇,即給ai agent一個“選擇輪”,生成多個計劃,挑一個最好的來執行;外部模塊輔助規劃,即藉助外部規劃器,類似強化學習的判官。記憶增強規劃,就像 一個記憶麵包,記住過去經驗,為將來規劃提供幫助。這些方法並不孤立,而是相互交織,共同提升ai agent的規劃能力。

一年以來,agent“皮下”各項能力均取得了進步,其中tool use能力已經初步落地;記憶機制的進步非常值得期待;llms的進步則取決於巨頭的能力邊界等等。但對於agent而言,其能力的最大化並非各項技術簡單的加成,任何一項技術的突破均有望使其迎來質變。

未來,ai agent進化的重要挑戰包括但不限於:如何實現低延遲、帶視覺理解的實時反饋;如何構建個性化的記憶系統;如何在虛擬與物理環境都具備魯棒的執行能力等等。只有當ai agent從“工具”到“工具使用者”時,真正的killer agent就會出現。

2、資本的選擇–大模型遇冷,ai agent當立

有人說,現在大模型卷不動了,要卷就卷ai agent。

2024年,曾經爭做“做中國openai”的大模型公司不得已食言,以“六小虎”智譜ai、零一萬物、百川智能、minimax、月之暗面和階躍星辰為例,多數公司已經開始進行業務調整,甚至人員縮減。大廠憑藉其雄厚的家底,還能繼續卷研發;更多初創企業被迫直面現實,轉向大模型應用層面,尋求更低的成本和更快的回報。

同時,敏銳的資本也將目光投向了ai應用層。

桔子it數據顯示,2024年前9個月,國內ai領域發生了317起融資案例,月均融資金額42億元,不到去年的兩成。其中,融資最多的5家公司拿走了超212億,相當於今年國內ai融資總額的63%。

值得注意的是,大模型和ai agent項目受投資人的關注度最高–大模型發生19起融資案,ai agent發生了18起。其次是ai視頻生成(10%),剩下50%投資案例的方向較為分散,被19個方向瓜分。

由此,在大模型“贏家通吃”的局勢下,ai agent既是ai初創公司的最佳方向,也是海內外資本的篤定之選。

yc合伙人、資深投資人jared指出,垂直領域 ai agent 作為一種新興b2b 軟體,有望成為比saas大10倍的新興市場。憑藉替代人工操作、提升效率的顯著優勢,這一領域可能催生出市值超過3000億美金的科技巨頭。

投資人所看中的ai agent都長什麼樣?

最出圈的當屬ai編程神器cursor。原因不外於代碼是llms最容易掌握的能力,其生成的訓練數據主要來自github上的開原始碼,大部分都是“有效數據”。此前,cursor是根據用戶需求,提供建議代碼。如今,cursor可以直接以實現需求為目的,一口氣幫助你創造代碼文件,準備好運行環境。你只需點擊啟動按鈕,就可以運行代碼。

除此之外,即便2024年尚未產生真正的killer agent,但實際上在細分領域,agent已經有遍地開花之勢了。

根據yc團隊的最新分享。目前已經獲得投資的agent項目大多在tob領域。

問卷調查和分析:outset將 ai agent應用於問卷調查和分析領域,可以替代傳統的人工調查和分析工作,例如 qualtrics等公司提供的服務。

軟體質量測試:mtic利用 ai agent進行軟體質量測試,可以完全取代傳統的 qa 測試團隊。與之前的 qa 軟體即服務公司(如 rainforest qa)不同,mtic不僅提高了qa 團隊的效率,還能完全取代人工測試。

政府合同競標:sweet spot利用 ai agent自動搜索、填寫政府合同的標書,可以替代人工完成這些繁瑣的任務。

客戶支持:powerhelp利用 ai agent,自動完成人工接聽電話、回覆郵件和解決問題,並且能夠根據用戶提問和歷史記錄提供個性化的解決方案,提升其滿意度。

人才招聘:priora和nico,利用 ai agent進行技術篩選和初步招聘,可以替代人工完成這些任務。

用吳恩達的發言做總結:通往 agi 的道路感覺更像是一段旅程,而不是一個目的地。但我認為agent式工作流,可以幫助我們在這個非常漫長的旅程中向前邁進一小步。換句話說,即便我們暫時無法擁有“全能agent”,但多個垂直領域的專業agent逐漸出現,將讓我們不斷獲得近似擁有jarvis的體驗。

3、2025年:有望成為ai agent商用爆發元年

近日,前openai聯創、ssi創始人 ilya sutskever直接宣布:預訓練從此將徹底終結–我們只有一個網際網路,訓練模型需要的海量數據即將枯竭,唯有從現有數據中尋找新的突破,ai才會繼續發展。

sutskever用人類大腦發展進行類比:正如人類大腦體積停止生長後,人類智慧仍在進步。ai未來發展將轉向在現有llm上構建 ai agent和工具。他預測,以後的突破點,就在於智能體(agentic)、合成數據和推理時計算。其中,能夠自主完成任務的ai agent,是未來的發展方向。

值得注意的是,與吳恩達一樣,sutskever同樣使用“形容詞”agentic描述智能體。

根據線性資本bolt觀點:我們可以用少量的、適量的、高度的agentic“能力”描述agent應用的能力。例如,router(路由)類系統使用llm將輸入路由到特定的下游工作流中,具有少量的agentic能力;state machine(狀態機)類系統使用多個llms來執行多個路由步驟並且有能力確定每個步驟是繼續還是完成,具有相當的agentic能力;而autonomous(自主體)類系統更進一步,能夠使用工具甚至創造合適的工具去推進系統的進一步決策,具備完全的agentic能力。

基於此,廠商在強調產品的agent屬性前,不妨先回答“how agentic my system is?”

當前不少領域的專業ai agent依然不夠成熟。相關調查顯示,輸出不精確、性能差強人意、用戶不信任等問題困擾其落地。但如果我們換個思路:短期內商業化最成功的ai agent,不一定是看起來“agentic化”最高的產品;而是能夠平衡性能、可靠性,以及用戶信任的產品。

順著這條思路,專業ai agent最有前途的發展道路可能是:先重點應放在利用ai增強現有工具,而不是提供廣泛的全自主獨立服務。

用人機協同的方法,讓人類參與監督和處理邊緣案例。根據當前的能力和局限,設定不脫離現實的期望。通過結合嚴格約束的llms、良好的評估數據、人機協同監督和傳統工程方法,在自動化等複雜任務方面實現可靠且良好的效果。

例如,紅杉投資組合中的rocks公司,其agent是將人類員工融入其中。最初,rocks開發了一項自動撰寫、自動發送電子郵件的技術。但他們發現將人類銷售納入流程時,表現提升了333倍。於是,rocks移除了自動發送的功能。

根據具體業務場景,有些公司可以開發agent完成任務的技術,比如網絡安全領域的expo;而有些公司則儘量選擇用agent“增強”人類員工,比如rocks。

那麼,2025年會發生什麼?

首先,不止是編程,更多垂直領域將跑出“種子選手”。紅杉合伙人 konstantine buhler預測:醫療和教育等“高服務成本”領域將成為 ai 技術的下一個重要戰場。

同時,根據langchain報告顯示:人們希望將耗時任務交給ai agent–充當“知識過濾器”:快速提煉關鍵信息,用戶無需自己手動篩選海量數據;“生產力加速器”:協助用戶安排日程、管理任務,讓人類專注於更重要的工作;“客服神助攻”:幫助企業更快地處理客戶諮詢、解決問題,大幅提升團隊的響應速度。

換句話說,所有耗時、耗力、耗成本的工作有望率先被垂直領域專業ai agent替代。

其次,ai agent部署將由“單”變“多”。一方面,ai agent將從單一智能體發展到“群體協作”模式。2025年會出現更多multi-agent模式,多個agent 扮演不同角色合作完成任務。例如,清華面壁智能的開源項目chatdev。每個 agent 被賦予了不同的身份,有的是 ceo,有的是產品經理,有的是程式設計師,它們能夠彼此互相合作,共同完成任務。

另一方面,隨著⼤模型對圖像和視頻信息的處理能⼒快速提升,2025年將開始出現更為綜合性的多模態交互,ai能夠通過物聯⽹、特定信息等多種感知通道進⾏協同。多模態輸⼊和輸出使ai交互性更強、交互頻次更⾼,適⽤場景也更加豐富,ai產品整體⽔平顯著提升。

其中,agent作為融合感知、分析、決策和執⾏能⼒的智能體,其交互的主動性和⾃動化遠超現有工具。

根據量子位智庫觀察:從技術和配套設施兩⽅⾯發展來看,從2025年開始,ai agent即將⼴泛投⼊使⽤。ai agent有望帶來獨屬於ai 2.0時代的交互⽅式、產品形態和商業模式。

結語

在電影《2001:太空漫遊》的開頭,一群草食人猿掙扎在飢餓和死亡的邊緣,人猿首領偶然揮舞了一下手裡的棒骨,“發現”它居然是一件趁手的工具。從此,他們開始狩獵小動物,成為食肉動物,逐步站上了食物鏈頂端。

如果未來的人類俯瞰2025年,可能會發現,這又是一個人類進化的關鍵時刻,而ai agent正是那根趁手的“棒骨”。

正如andrej karpathy所言,ai agent代表著一個瘋狂的未來。

有趣的是,agent一詞源於拉丁語的agere,意思是“to do”。

如何抓住這個瘋狂的未來?你可能只需要“agent”。

原文網址:https://zh.gushiio.com/ai/177.html